Linux 基金會於週二宣布啟動企業AI開放平台(OPEA),這是一項旨在推動開放、多供應商和可組合(即模塊化)生成型AI系統發展的項目。這個項目由 Linux 基金會的 LF AI 和數據組織負責,該組織專注於AI與數據相關的平台倡議,旨在為釋出堅固、可擴展的生成型AI系統鋪平道路,這些系統將利用來自生態系統各地的最佳開源創新。

「OPEA 將通過創建一個詳盡、可組合的框架來解鎖AI的新可能性,該框架站在技術堆棧的最前沿,」LF AI 和數據的執行董事 Ibrahim Haddad 在新聞稿中表示。「這項倡議是我們推動開源創新和在一個中立及開放的治理模型下促進AI與數據社群合作的使命的見證。」

除了 Cloudera 和 Intel,OPEA 還包括諸如 Intel、IBM 旗下的 Red Hat、擁抱者臉(Hugging Face)、Domino 數據實驗室、MariaDB 和 VMware 等企業重量級成員。

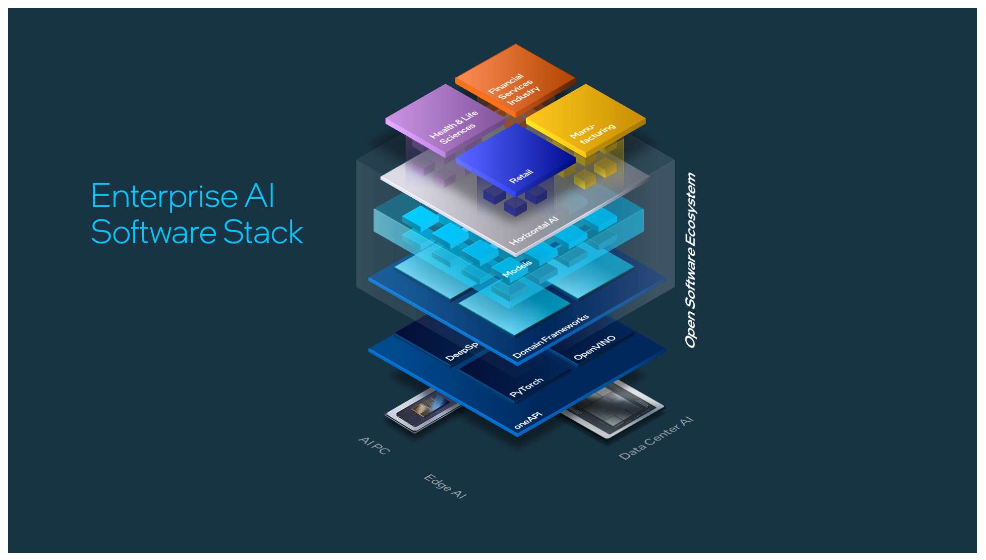

那麼他們究竟會一起構建什麼呢?Haddad 暗示了一些可能性,比如為AI工具鏈和編譯器提供「優化」支援,使AI工作負載能夠在不同的硬體組件上運行,以及用於檢索增強生成(RAG)的「異質」管道。

在企業應用中,RAG 正變得越來越受歡迎,這並不難理解。大多數生成型AI模型的答案和行動僅限於它們的訓練數據。但有了 RAG,模型的知識基礎可以擴展到原始訓練數據之外的信息。RAG 模型會在生成響應或執行任務之前參考這些外部信息——這些信息可能是專有公司數據、公共數據庫或這兩者的組合。

Intel 在其新聞稿中提供了更多細節:

企業面臨一種自行研發的挑戰,因為缺乏跨組件的事實標準,使得企業難以選擇並部署開放且互操作的 RAG 解決方案,這些解決方案可以幫助他們快速進入市場。OPEA 打算通過與業界合作來解決這些問題,標準化組件包括框架、架構藍圖和參考解決方案。

評估也將是 OPEA 著手解決的關鍵部分。

在其 GitHub 中,OPEA 提出了一個評分生成型AI系統的標準,包括四個軸:性能、功能、可信度和「企業級」準備。性能按 OPEA 的定義涉及來自實際使用案例的「黑盒」基準。功能是對系統的互操作性、部署選擇和使用便利性的評估。可信度檢視了AI模型確保「穩健性」和質量的能力。企業準備則專注於啟動系統而不會遇到重大問題的要求。

Intel 的開源戰略主任 Rachel Roumeliotis 表示,OPEA 將與開源社群合作,根據這個標準提供測試,同時還將提供生成型AI部署的評估和評分服務。

OPEA 的其他努力目前還有些不確定。但 Haddad 提出了開放模型開發的可能性,類似於 Meta 正在擴展的 Llama 家族和 Databricks 的 DBRX。為此,在 OPEA 儲存庫中,Intel 已經為其 Xeon 6 和 Gaudi 2 硬體優化的生成型AI驅動的聊天機器人、文檔摘要器和代碼生成器貢獻了參考實現。

現在,OPEA 的成員顯然都非常投入(而且出於自身利益)於為企業生成型AI構建工具。Cloudera 最近發起合作夥伴關係,創建了所謂的雲中「AI生態系」。Domino 提供了一套用於構建和審計面向業務的生成型AI的應用程序套件。以及 VMware——朝向企業AI基礎設施方面——去年八月推出了新的「私有AI」計算產品。

問題是,這些供應商是否真的會共同努力,在 OPEA 下構建兼容的 AI 工具。

這樣做顯然有好處。客戶會根據他們的需求、資源和預算,樂於利用多個供應商的產品。但歷史已經顯示,過於傾向於供應商鎖定是很容易的。讓我們希望這不會是這裡的最終結果。