你有沒有發現,網路上每天都在丟新東西給你:迷因像雨點一樣落下、梗圖像子彈一樣掃過、圖片跟表情包像海嘯一樣淹來。你一邊笑到不行,一邊又開始煩:到底要把這些東西放哪?要用什麼方法整理?要怎麼把「好笑」變成「好用」?

於是各種「收納庫」型的平台就紅了——不是那種只會堆檔案的倉庫,而是能把來源、原因、脈絡都一起存下來的地方。你需要的不是更多分頁,而是更少的混亂:一個平台把網路上的有趣(迷因、梗圖、圖片)跟有用(工具、程式、模型)串起來,最好還能讓你一邊玩、一邊做事。

而 Osaurus 的爆紅,剛好踩在這個節奏上:它把「本地 AI」做得更像 Mac 原生工具,讓你不必為了跑模型去堆一堆 wrapper;你想測、就直接跑,想串、就直接接。更重要的是——它讓 Apple Silicon 的效能真的有地方可以發揮。

AI 工具精選

LLM 伺服器與模型(先搞懂為什麼大家要「本地跑」)

這一年大家講 LLM,常常講到像宗教。但你冷靜想一下,很多人真正想要的是三件事:

- 速度:少一點等待,多一點即時回應

- 隱私:不要每次丟資料都要出網路

- 控制:能自己選模型、自己調參數、自己串工具

雲端當然方便,但只要你想「更像自己掌控自己的電腦」,本地跑模型就會變成一種理想——只是現實很骨感:安裝麻煩、效能打折、工具不原生,還容易變成「我到底在裝什麼」。這就是 Osaurus 被拿出來討論的原因。

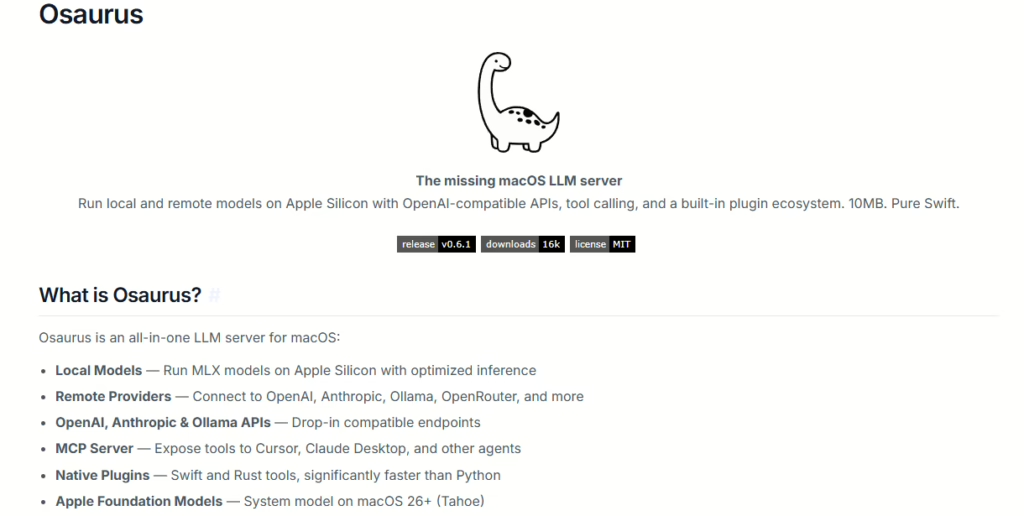

而Osaurus 超快速 Apple Silicon 原生本地 LLM 伺服器,效能媲美 Ollama

Osaurus 是 Dinoki Labs 做的 macOS 全方位 LLM 伺服器,主打「Apple Silicon 原生」。它把本地推論交給 MLX 這條路線,並用「伺服器 API 相容」來降低你搬家成本:你原本用 OpenAI SDK、或習慣 Ollama 的路徑,很多情境都能直接接。

你可以把它想像成:

一個在 Mac 上跑的「本地模型後端」,外面用 /v1/chat/completions 這類 API 去叫它吐字(文字),需要串流就串流;想把它接到你的內部工具、或 AI Agent 平台,也更容易。

它之所以「看起來很紅」,往往不是因為它做了什麼玄學,而是它把幾個痛點一次抹平:

用 MLX 走 Apple Silicon 的最佳化路線,讓效能更像在跑原生,而不是「硬塞」

用 Swift/SwiftUI 的原生思維做成一個可操作的 App(不是只給你 CLI 然後叫你自己想辦法)

用相容 API 讓你「少改程式」,把你原本的工具鏈直接搬過來

如果你平常在 Mac 上做開發,你就會懂這個差異:不是「能跑」而已,是「跑得像你本來就該這樣跑」。

AI 輔助工具(從「會用」走到「會串」)

不要只蒐集工具,要把它們串成流程。否則你只是把 10 個新玩具丟進收納庫,最後依然只會打開、關掉、再打開。

H4: 3 小時掌握自動化工作新手應用實作 – n8n AI Agent

n8n 的魅力在於它逼你用「流程思維」做事:你拖拉節點、接資料來源、丟進 LLM、再把結果送出去。它也把 AI Agent 的概念包進產品裡,讓你更容易做出「會自己跑完一串任務」的自動化。

如果你把 Osaurus 當本地伺服器,n8n 就像你的流程總控台:

- 你讓 n8n 抓資料(網路、文件、表單)

- 丟給本地模型做摘要、分類、抽關鍵字

- 再把輸出回填到 Notion / Slack / Google Sheet(或你自己的系統)

你會得到的是一個能「自動整理」的收納庫,而不是一個只會堆東西的資料夾。

實測範例

Osaurus 相容 OpenAI API,所以第一步就是直接打 /v1/chat/completions。

curl http://localhost:11434/v1/chat/completions \

-H "Content-Type: application/json" \

-d '{

"model": "mlx-community/Llama-3.1-8B-Instruct",

"messages": [

{ "role": "system", "content": "你是一個幽默的科技部落客" },

{ "role": "user", "content": "用迷因風格解釋什麼是本地 LLM" }

]

}'

model:Osaurus UI 裡下載過的模型名稱messages:完全照 OpenAI 標準- 不用 API key(本地跑)

JavaScript(Node.js / 前端 / n8n 都能用)

const res = await fetch("http://localhost:11434/v1/chat/completions", {

method: "POST",

headers: {

"Content-Type": "application/json"

},

body: JSON.stringify({

model: "mlx-community/Llama-3.1-8B-Instruct",

messages: [

{ role: "user", content: "幫我把這段文字改寫成梗圖語氣" }

],

temperature: 0.8

})

});

const data = await res.json();

console.log(data.choices[0].message.content);

Osaurus 官網:https://osaurus.ai/

Github:https://github.com/dinoki-ai/osaurus?utm_source=chatgpt.com