法國的 AI 初創公司 Mistral 以其強大的開源 AI 模型聞名,今日發布了兩款新型的大型語言模型(LLM),分別是一個基於數學的模型和一個專為程式員和開發者設計的代碼生成模型,這些模型基於去年底由其他研究人員開發的新架構 Mamba。

Mamba 旨在通過簡化注意力機制來提高變壓器架構的效率。與更常見的變壓器架構模型不同,基於 Mamba 的模型具有更快的推理時間和更長的上下文處理能力。包括 AI21 在內的其他公司和開發者也已經基於這一架構發布了新的 AI 模型。

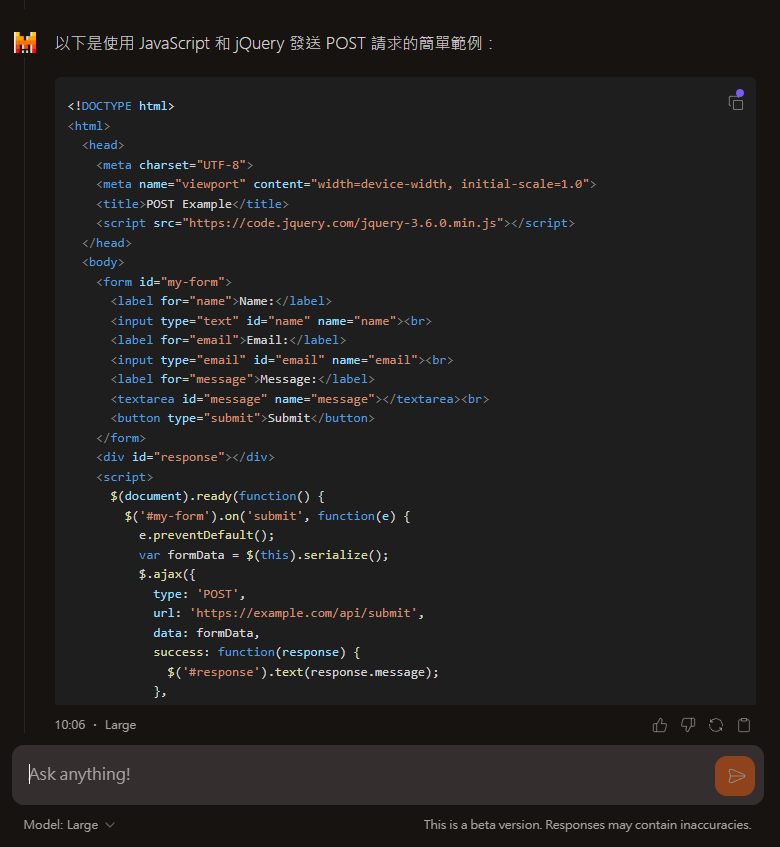

現在,Mistral 推出的名為 Codestral Mamba 7B 的模型使用了這一新架構,即使在處理更長輸入文本時也能提供快速的響應時間。Codestral Mamba 尤其適合於本地代碼項目中的代碼生產力使用案例。

Mistral 測試了這個模型,並將其免費提供在 Mistral 的 la Plateforme API 上,能夠處理多達 256,000 個 tokens 的輸入,這是 OpenAI 的 GPT-4o 的兩倍。

在基準測試中,Mistral 表示 Codestral Mamba 在 HumanEval 測試中表現優於其他開源模型,如 CodeLlama 7B、CodeGemma-1.17B 和 DeepSeek。

開發者可以從其 GitHub 存儲庫和 HuggingFace 中修改和部署 Codestral Mamba。這款模型將以開源 Apache 2.0 許可證提供。

Mistral 表示,早期版本的 Codestral 的表現優於其他代碼生成器,如 CodeLlama 70B 和 DeepSeek Coder 33B。

代碼生成和代碼助手已成為 AI 模型廣泛應用的場景,GitHub 的 Copilot(由 OpenAI 提供支持)、Amazon 的 CodeWhisperer 和 Codenium 等平台越來越受歡迎。

Mistral 的第二個模型是 Mathstral 7B,一款專為數學推理和科學發現設計的 AI 模型。Mistral 與 Project Numina 合作開發了 Mathstral。

Mathstral 擁有 32K 的上下文窗口,並將在 Apache 2.0 開源許可證下提供。Mistral 表示,該模型在數學推理領域表現優於所有其他模型。它可以在基準測試中通過更多推理時間計算實現「顯著更好的結果」。用戶可以直接使用該模型或進行微調。

Mistral 在一篇博客文章中表示:「Mathstral 是針對特定用途構建模型時所達到的優秀性能/速度折衷的另一個例子——這是我們在 la Plateforme 中積極推廣的開發理念,尤其是其新的微調功能。」

Mathstral 可通過 Mistral 的 la Plateforme 和 HuggingFace 獲取。

Mistral 一直在開源系統上提供其模型,並穩步與 OpenAI 和 Anthropic 等其他 AI 開發商競爭。

該公司最近在 B 輪融資中籌集了 6.4 億美元,將其估值提高到接近 60 億美元。該公司還獲得了來自微軟和 IBM 等科技巨頭的投資。

AI 網址:Le Chat - Mistral AI