過去談到大型語言模型的強化學習,許多人會直接聯想到高成本 GPU、複雜的 RLHF 管線、昂貴的訓練環境,以及需要多人團隊維護的基礎設施。尤其是 PPO、RLHF、RFT、GRPO 這類訓練方法,對一般開發者而言,往往停留在論文、教學文章或大型 AI 實驗室的發表內容中。

但這次 Unsloth 宣布在 Gemma 4 上啟用強化學習功能,並提供免費 Notebook,讓使用者只需要約 9GB 記憶體,就能在本地或 Colab 環境中執行 Gemma 4 的強化學習範例。這讓「模型透過獎勵函數自主學習任務」不再只是高門檻實驗,而是變成可以被一般人打開、執行、修改的實作流程。Unsloth 官方文件也指出,它主打讓使用者在本地硬體上執行與訓練開源模型。

Gemma 4 強化學習突然變得更親民,從「只能大公司玩」到「一般開發者也能碰」

本次消息有幾個值得放大的重點:

第一,Gemma 4 可以透過 GRPO 進行強化學習。

第二,官方提供的範例任務是讓 Gemma 4 學會自主解數獨。

第三,Unsloth 表示這套流程只需要約 9GB 記憶體即可執行 Gemma 4 E2B RL。Unsloth 的 Gemma 4 訓練文件也提到 Gemma 4 E2B RL 可在 9GB 記憶體下運作。

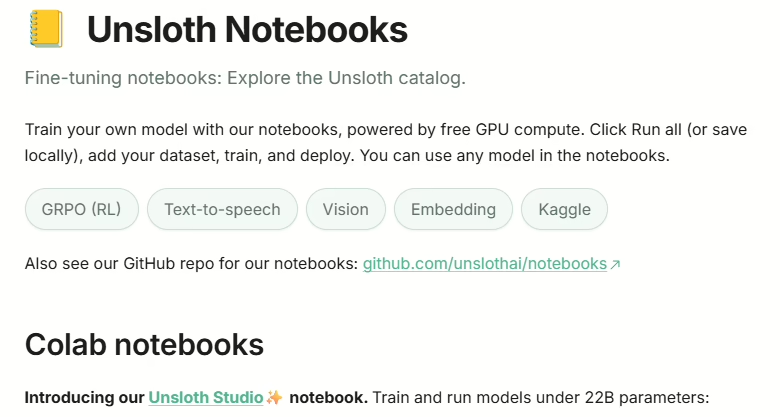

第四,Unsloth Notebook 讓使用者可以用免費 GPU compute 快速嘗試微調、RL、視覺、語音、Embedding 等不同模型訓練流程。

第五,這不是單一模型的封閉範例,而是 Unsloth 強調「works on all the models of course」,代表 GRPO 訓練概念可以延伸到其他模型與任務。

詳情:

https://unsloth.ai/docs/models/gemma-4/train

https://unsloth.ai/docs/get-started/unsloth-notebooks

Unsloth

Unsloth 是一個開源模型訓練與微調框架,主要目標是降低模型訓練成本,讓開發者能用更少 VRAM、更快速度完成微調、強化學習、預訓練與模型部署。根據 Unsloth GitHub 頁面介紹,它支援 full fine-tuning、RL、pretraining、4-bit、16-bit、FP8 training 等訓練模式,並宣稱可支援 500 多種模型訓練與 RL。

這類工具對一般開發者很關鍵,因為多數人沒有企業級 GPU 叢集,也不一定能長時間租用 A100、H100、B200 這類高階設備。因此,能否在消費級 GPU、免費 Colab 或較低 VRAM 環境中完成訓練,會直接影響 AI 實驗能不能普及。

Unsloth 解決的問題

這段可以從三個角度寫:

降低 VRAM 需求

大型模型訓練最直接的瓶頸就是記憶體。即使只是微調模型,也會受到模型權重、梯度、optimizer state、activation、batch size、context length 等因素影響。

Unsloth 的特色之一,就是透過最佳化 kernel、量化、LoRA、QLoRA、記憶體管理與訓練流程優化,降低模型訓練的 VRAM 需求。Unsloth GitHub 說明中也提到,它在 GRPO、FP8 等 RL 場景中可使用更少 VRAM。

加速訓練流程

除了省記憶體,訓練速度也很重要。官方 Colab Notebook 說明中提到,Unsloth 可節省約 70% VRAM,並讓強化學習快 2 到 6 倍。參考:https://colab.research.google.com/github/unslothai/notebooks/blob/main/nb/Gemma4_%28E2B%29_Reinforcement_Learning_Sudoku_Game.ipynb

降低入門難度

Unsloth 提供大量 Notebook,讓開發者不用從零開始寫訓練腳本。這對剛接觸 LoRA、GRPO、RL、SFT 的人很重要,因為 Notebook 把資料格式、模型載入、訓練設定、推論測試、儲存模型等步驟都整理成可執行流程。

Gemma 4 是什麼?為什麼這次搭配 Unsloth 受到關注?

Gemma 是 Google 推出的開放權重模型系列,主打輕量、可部署、可微調,適合研究、開發、產品原型與本地 AI 應用。Gemma 4 作為新一代模型,除了延續輕量化特色,也開始往多模態、長上下文、低記憶體訓練與本地推論方向發展。

Unsloth 文件中已經將 Google Gemma 4 作為可執行與訓練的模型類別,並提供 Gemma 4 相關訓練指南。

Gemma 4 E2B 的角色

這次 Notebook 使用的是 Gemma 4 E2B。從命名來看,E2B 是較小型、較容易在低資源環境執行的版本,適合作為 RL 入門範例。